Doblaje de videos a otros idiomas - Análisis y Particularidades

¿Te gusto este contenido? Únete a la comunidad de Indie Builders y descubre las mejores formas de crear un producto digital. clic aquí

¿Te gusto este contenido? Únete a la comunidad de Indie Builders y descubre las mejores formas de crear un producto digital. clic aquí Seguramente en algun momento te has preguntado como Mr. Beast o Johnny Harris doblan sus videos a multiples idiomas en Youtube, Mr Beast por ejemplo contrata un actor de doblaje y un editor de audio, mientras que Johnny Harris utiliza un clonador de voz basado en su timbre de voz para obtener un video homogeneizado en un idioma distinto, luego lo agregan en una pista de audio de configuración en Youtube y logran expandir el alcance de sus videos a otros paises.

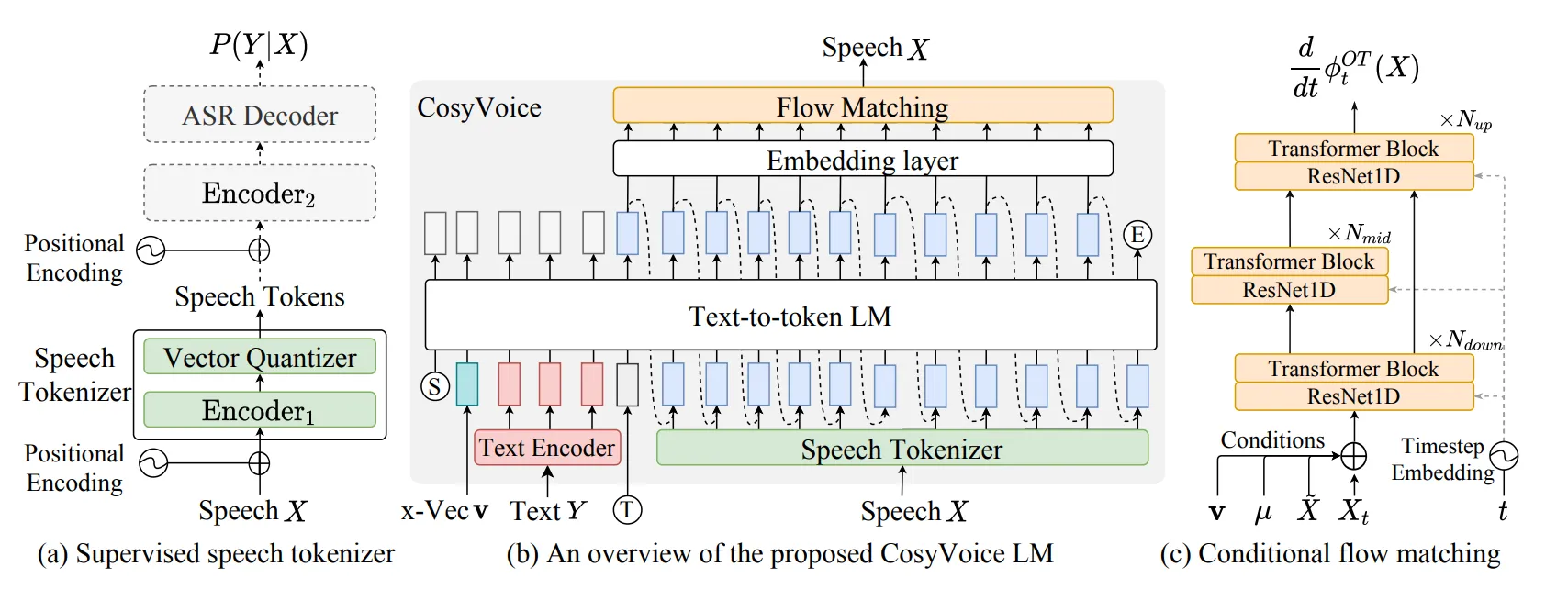

Los clonadores de voz por lo general utilizan arquitecturas de tipo CosyVoice (Modelo Texto-to-Speech) combinando con recursos multimodales, por ejemplo utilizando un audio de referencia se puede tokenizar, realizar un analisis de espectro, usar un transformer, un flow matching y un vocode combinado con el texto y se obtendra la clonación del audio.

Si bien podria seguir con el aspecto tecnico de como se puede crear un clonador de voz muy superficialmente, la idea de este post es de la aplicabilidad, por lo que realizare un pequeño ensayo de pruebas y experimentación. Por ejemplo utilizare mi ambiente local para replicar una clonación de voz utilizando Chatterbox.

Instalare las librerias indispensables en el ambiente local, utilizaremps pip ya que chatterbox esta escrito en python, y endonde la documentación menciona previamente debo tener instalado torch.

pip install chatterbox-ttsClonare el repositorio de chatterbox, y en la que menciona que se debe tener una versión de python superior a la 3.11.

git clone https://github.com/resemble-ai/chatterbox.git

cd chatterbox

pip install -e .Para ya empezar a utilizarlo y en su versión mas moderna llamada Turbo, se necesita crear un archivo que en este caso sera llamadoclon-voice.py y dentro de la carperta de chatterbox, aqui debes tener preparado un archivo de tu voz con un minimo de 10 segundos llamado voice-reference.wav, y un obtendrás de salida un archivo como output-voice-en.wav.

import torchaudio as ta

import torch

from chatterbox.tts_turbo import ChatterboxTurboTTS

# Load the Turbo model

model = ChatterboxTurboTTS.from_pretrained(device="cuda")

# Generate with Paralinguistic Tags

text = "There's a guy who, in 2014, opened a laptop in a cafe in Thailand and built Nomad List."

# Generate audio (requires a reference clip for voice cloning)

wav = model.generate(text, audio_prompt_path="voice-reference.wav")

ta.save("output-voice-en.wav", wav, model.sr)Puedes observar que en la variable wav llamo al modelo y uso como entrada al audio voice-reference, que seguramente sera tokenizado para obtener la clonación de voz.

Voz de referencia

0:00 / 0:00Para obtener los resultados ejecuto el archivo de python.

python3 clon-voice.pyComo puedes observar en la variable text es donde se coloca el texto que quieres que se transforme en un audio, y en este ejemplo el audio dira:

There’s a guy who, in 2014, opened a laptop in a cafe in Thailand and built “Nomad List.”

Voz clonada en inglés

0:00 / 0:00Pero usaremos como ejemplo tambien al frances y al japones para observar su comportamiento.

Il y a un type qui, en 2014, a ouvert son ordinateur portable dans un café en Thaïlande et a créé « Nomad List ».

Voz clonada en frances

0:00 / 0:002014年、タイのカフェでノートパソコンを開き、「Nomad List」を作った男がいた。

Voz clonada en japones

0:00 / 0:00Al reproducir las voces clonadas en otro idioma, se puede evidenciar la naturaleza del lenjuaje sobre el tiempo de decir una oración, en tanto en español como en ingles duro 6 segundos decir la frase completa, mientras que para el frances y japones tardo 10s y 7s respectivamente. Aunque con un actor de doblaje obviamente se puede ajustar estos tiempos modificando el guión, utilizando sinonimos del idioma.

Uso de archivos .srt o .json

Ahora como sabras el audio de un video es muy espontaneo, es decir contiene pausas, acentos, y recursos del lenguaje que al utilizar en el script anterior se obtendria una voz demasiada artificial y que exista un desfase con las imagenes del video.

En este caso podemos hacernos de la ayuda de los arhcivos .srt o .json (de subtitulos), en este formato se guardara el texto que se dice en un audio, puedes usar las herramientas de tu editor de video favorito ya sea capcut, final cut, adobe premiere o davinci resolve. En mi caso usaré una herramienta de licencia libre como lo es Autosubs para obtener el archivo .srt de un video propio publicado días atras.

Este nos proveera los siguiente:

- El guión del video

- Los tiempos usados por el guión

Estos archivos tambien pueden o no traer el locutor del guión, y puedes generar una clonación de audio de varias voces para mejorar la calidad del audio. Extraere de una porción del guión del video que mencione anteriormente.

1

00:00:00,040 --> 00:00:06,009

Hay un tipo que en 2014 se abrió una laptop en un café de taillandia y construyó "Nomad Liz".

2

00:00:06,280 --> 00:00:08,960

Sin equipos, sin inversores, sin oficina,

3

00:00:09,000 --> 00:00:12,150

y hoy factura casi 3 millones de dólares al año.Si observas el .srt, se puede rescatar lo siguiente:

- La segmentación enumeradas de las oraciones del guión

- Las marcas de tiempo de inicio y fin

- La oración del guión

- Y en algunas ocasiones, se puede mostrar el locutor con un número de identificación

Con esta información podemos crear un script que mantenga una fase de acuerdo a los tiempos establecidos, y de esta manera fasar el audio de la pista del doblaje. Pero hay que recordar que lo que se quiere hacer es un doblaje a otro idioma con el mismo timbre de voz, para este caso de español a ingles, y se debe traducir el guion, podemos usar Claude Code, Codex, Gemini o cualquier otro LLM para este proposito:

1

00:00:00,040 --> 00:00:06,009

There's a guy who, in 2014, opened a laptop in a cafe in Thailand and built "Nomad List."

2

00:00:06,280 --> 00:00:08,960

No team, no investors, no office,

3

00:00:09,000 --> 00:00:12,150

and today it brings in almost 3 million dollars a year.Lenguajes, acentos y particularidades de agrupación

Por la propia estructura y formación de cada idioma, un lenguaje se puede tardar en decir una misma frase en mas o menos tiempo que en otro lenguaje, por lo que dependera de las ideas que se transmite en un video y la “calibración” del guión para encajar a la perfección.

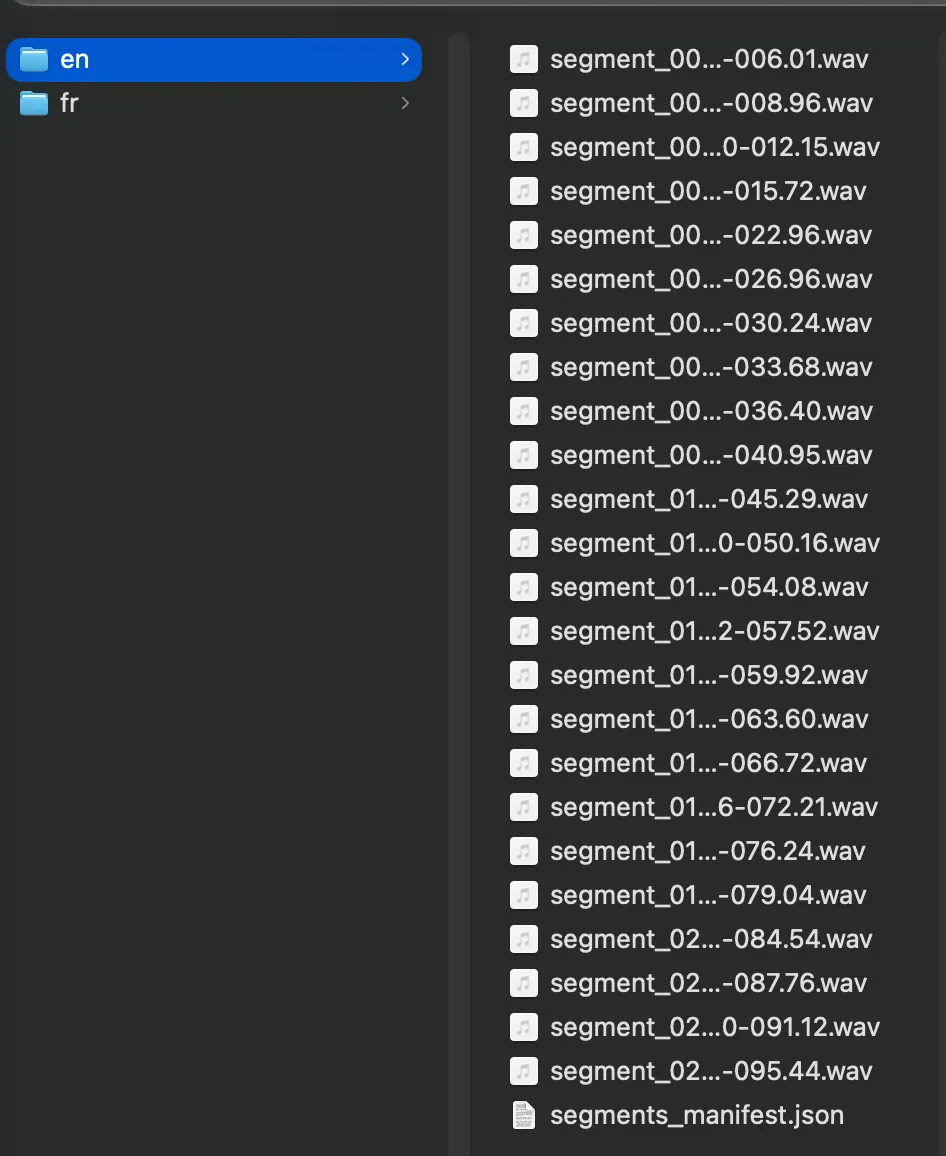

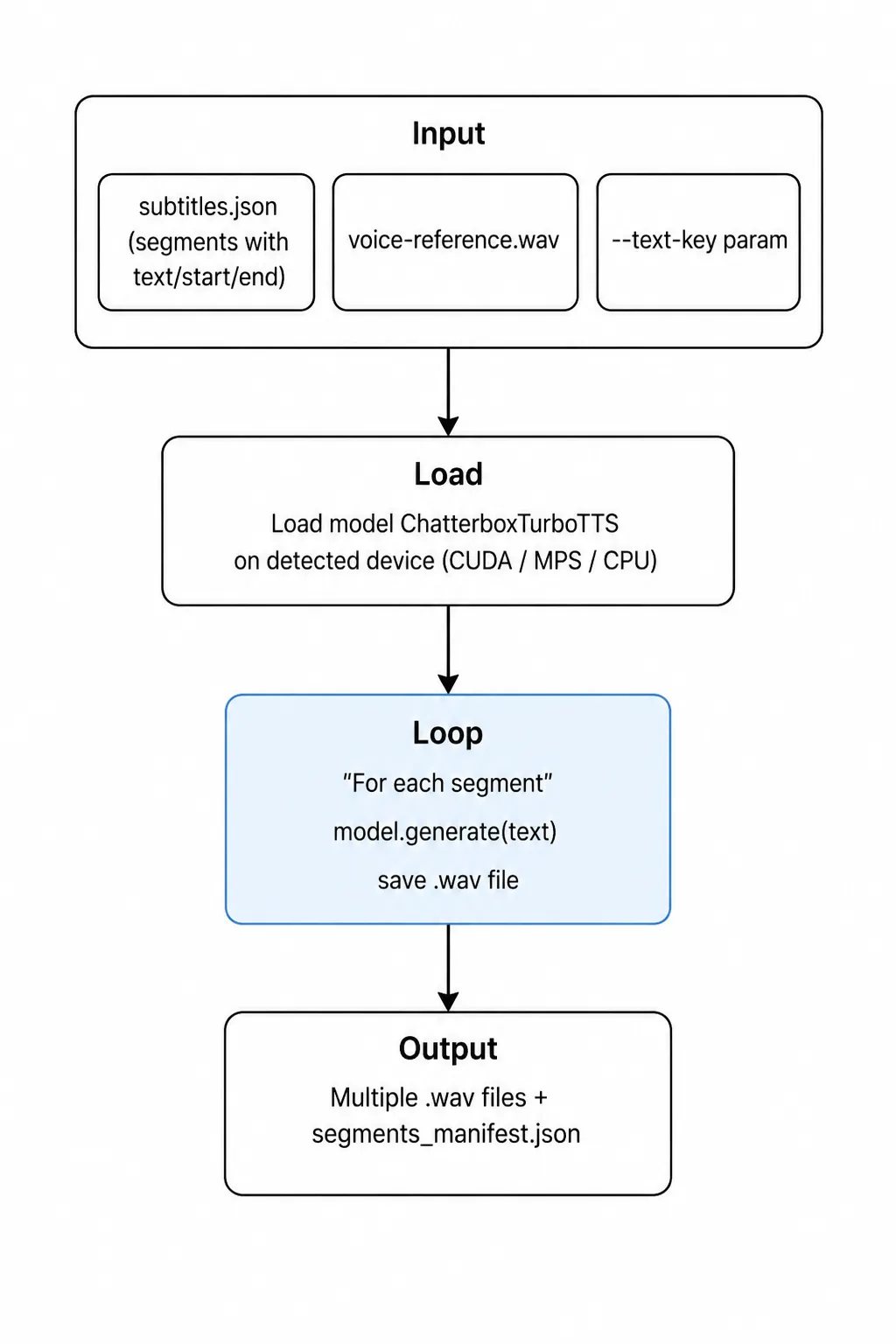

Para lograr fasar el doblaje con las imagenes deberemos crear un script de python que realice lo siguiente:

- Leer el archivo

.jsono.srtpara formar rangos de tiempos con los segmentos de las palabras - Generar la clonación de voz de cada segmento y obtener el archivo

.wav

Por lo que por cada segmento podremos obtener un numero X de archivos .wav que podremos utilizar en un editor de video para colar de acuerdo al locutor.

Y que la arquitectura seria:

Unión de segmentos

El resultado final lo puedes evidenciar, mantiene el timbre de voz, un acento en ingles casi neutral, y en la mayoria de los segmentos resguarda y respeta las marcas de tiempo de inicio y final, y las que no logra obtenerla se mantiene un silencio, que curiosamente me he fijado dichos silencios que existen en los videos de Johnny Harris. Usa la opción de “Cambiar Pista” en el video para revisar los resultados.

Ideas de comercialización

Como observas el modelo que acabamos de realizar ya es un producto miniamente viable (MVP) en potencia, con ciertos ajustos y despliegue se puede generar una lista de espera con una prueba gratuita para saber cuanto la gente esta dispuesta a pagar para doblar sus videos a otros idiomas utilizando una IA de clonación de voz.

Aunque para ser sinceros el nicho de mercado en el cuál puede funcionar esto es dentro de los editores de video y creadores de contenido. Un producto final puede ser un plugin para software de edición de video como davinci resolve, adobe premiere y final cut pro, donde para un audio de cualquier pista realice 1. la transcripción de audio a texto, 2. la traducción al idioma a doblar y por ultimo 3. la clonación de voz para el doblaje, tambien puede funcionar como una aplicación web de doblaje de audios en crudo para obtener su contraparte en otros idiomas con su mismo timbre de voz como lo hace elevenlabs.

Referencias

- Abebe, A. G., & Moslem, Y. (2026). One voice, many tongues: Cross-lingual voice cloning for scientific speech. arXiv. https://arxiv.org/html/2604.26136

- Du, Z., Chen, Q., Zhang, S., Hu, K., Lu, H., Yang, Y., Hu, H., Zheng, S., Gu, Y., Ma, Z., Gao, Z., & Yan, Z. (2024). CosyVoice: A scalable multilingual zero-shot text-to-speech synthesizer based on supervised semantic tokens. arXiv. https://arxiv.org/abs/2407.05407

- ElevenLabs. (s. f.). ElevenLabs. Recuperado el 12 de mayo de 2026, de https://elevenlabs.io/

- Harris, J. (s. f.). Johnny Harris [Canal de YouTube]. YouTube. Recuperado el 12 de mayo de 2026, de https://www.youtube.com/@johnnyharris

- Moroney, T. (s. f.). AutoSubs. Recuperado el 12 de mayo de 2026, de https://tom-moroney.com/auto-subs/

- Resemble AI. (2025). Chatterbox TTS [Repositorio de GitHub]. GitHub. https://github.com/resemble-ai/chatterbox

- Resemble AI. (s. f.). Chatterbox: Open source text-to-speech. Recuperado el 12 de mayo de 2026, de https://www.resemble.ai/learn/models/chatterbox

- Castillo, D. (2026). OpenClaw - Estado del Arte [Video]. YouTube. https://youtu.be/KQ3MnCnerw8

#Elevenlabs, #Chatterbox, #Youtube, #Clonación de voz, #Doblaje de audio, #Davinci Resolve,